在地质工程、石油勘探、碳封存等领域,岩石裂缝网络的精准识别与分析是核心任务之一。传统人工裂缝标注效率低、主观性强,而深度学习技术虽为自动化分割提供了可能,却受限于高质量标注数据集的匮乏。2024 年 12 月,由国际科研团队联合发布的GeoCrack 数据集,彻底打破了这一瓶颈 —— 它不仅是全球首个针对地质露头裂缝边缘分割的大规模开源数据集,更以其高分辨率、多场景、严质控的特性,为深度学习在地质裂缝分析领域的应用奠定了坚实基础。本文将从数据集背景、核心特性、构建流程、验证结果及应用价值等方面,全面解读 GeoCrack 的创新之处与科研意义。

一、为什么需要 GeoCrack?—— 数据集诞生的行业痛点

在地质工程领域,裂缝网络的形态(如长度、密度、连通性)直接决定了岩石的渗透性、强度等关键属性,进而影响油气藏开发效率、CO₂封存安全性、核废料处置选址甚至隧道边坡稳定性。长期以来,科研人员主要依赖两种方式获取裂缝数据:

- 井下观测(如井眼微电阻率成像):数据维度单一(准 1D),难以反映裂缝网络的三维分布;

- 地表露头观测:通过无人机或地面摄影获取高分辨率图像,再人工标注裂缝 —— 这种方式不仅耗时耗力(单张图像标注需数小时),还易受标注者经验、光照条件、植被遮挡等因素影响,导致数据一致性差。

随着深度学习(如 U-Net、Vision Transformer)在图像分割领域的突破,自动化裂缝提取成为可能。但高质量标注数据集的缺失,一直是制约技术落地的核心瓶颈:现有地质裂缝数据集要么规模小(仅数百张图像),要么场景单一(局限于某一岩性或区域),且未考虑真实环境中的干扰因素(如阴影、植被、岩石风化),与实际工程需求脱节。

GeoCrack 的出现,正是为了填补这一空白 —— 它以 “覆盖多地质场景、还原真实干扰因素、保证标注精度” 为核心目标,构建了首个符合深度学习训练需求的大规模裂缝边缘数据集。

二、GeoCrack 核心特性:数据规模与场景多样性的双重突破

GeoCrack 的核心优势可概括为 “大、全、精” 三个字,具体体现在以下四个方面:

1. 覆盖 11 个地质站点,横跨欧亚两大洲

数据集图像来源于欧洲(希腊、马耳他、意大利)和中东(阿曼、阿联酋)的 11 个典型地质露头区,涵盖了三大类岩性和多种构造背景:

- 沉积岩:碳酸盐岩、碎屑岩(如石灰岩、砂岩);

- 火成岩:超基性结晶岩(如橄榄岩);

- 构造背景:包括褶皱带、伸展盆地、断层带等,裂缝类型涵盖节理、断层、剪切裂缝、缝合线等。

这种跨区域、多岩性的设计,确保了数据集的泛化能力—— 基于 GeoCrack 训练的模型,可适应不同地质环境下的裂缝分割任务,而非局限于单一场景。

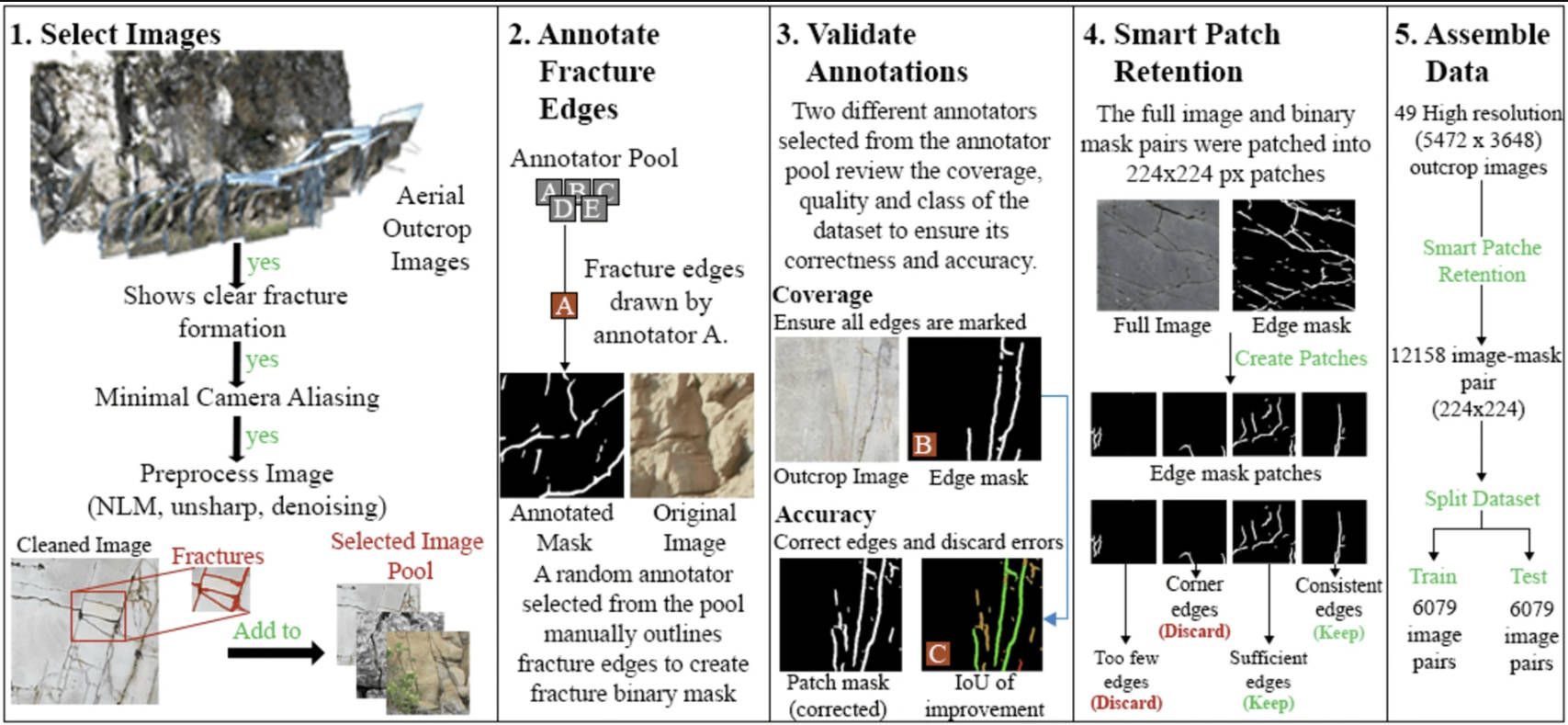

2. 12,158 对高质量图像 - 标签补丁,满足深度学习训练需求

原始数据来自 49 张高分辨率露头图像(分辨率 4032×3024 像素,300 DPI),经过预处理后,被切割为 224×224 像素的 “图像 - 标签” 补丁对(Patch),最终保留 12,158 对有效数据。这一尺寸选择并非随意:224×224 是 ResNet、VGG 等主流卷积神经网络的标准输入尺寸,既能保留足够的裂缝上下文信息,又能平衡计算效率(单张 GPU 可同时处理数十个 Patch)。

数据集按 50:25:25 的比例划分为:

- 训练集:6,079 对;

- 验证集:3,039 对;

- 测试集:3,040 对;并提供 CSV 格式的元数据文件,直接支持 PyTorch、TensorFlow 等框架的加载。

3. 还原真实干扰因素,拒绝 “理想态” 数据

与传统数据集刻意规避干扰不同,GeoCrack 主动纳入了地质露头观测中常见的8 类真实挑战,确保模型训练更贴近工程实际:

| 干扰类型 | 具体表现 | 对分割的影响 |

|---|---|---|

| 光照变化 | 阴影、强光反射 | 裂缝与岩石对比度降低,易漏检 |

| 植被遮挡 | 灌木、树根覆盖裂缝 | 裂缝边缘被截断,易误判为非裂缝 |

| 岩石风化 | 表面剥落、纹理杂乱 | 掩盖裂缝特征,增加背景噪声 |

| 地下水污染 | 裂缝内染色(如铁氧化物) | 裂缝与背景颜色混淆,边界模糊 |

| 人工干扰 | 爆破孔、测量工具(如卷尺) | 易被误判为裂缝,导致假阳性 |

| 裂缝形态复杂 | 分支裂缝、断续裂缝 | 裂缝连续性差,难以完整分割 |

| 岩性差异 | 深色岩石 vs 浅色岩石 | 裂缝对比度差异大,模型需自适应 |

| 图像 artifacts | 运动模糊、镜头畸变 | 裂缝边缘失真,影响分割精度 |

这种 “不回避问题” 的设计,让 GeoCrack 成为检验模型鲁棒性的 “试金石”—— 能在 GeoCrack 上取得优异成绩的模型,在实际工程中更具应用价值。

4. 人工标注 + 多层验证,确保像素级精度

为保证标签质量,GeoCrack 采用了 “人工标注 - 同伴审核 - 专家验证” 的三级质控流程:

- 人工标注:由经过培训的地质专业助手,使用 Adobe Photoshop 在清洁后的图像上手动追踪裂缝边缘,统一采用 3px 硬度 100% 的画笔,确保标注一致性;

- 同伴审核:两名标注者交叉检查,一人负责 “完整性”(是否遗漏小裂缝、边界裂缝),另一人负责 “精度”(是否多标、错标);

- 专家验证:由资深构造地质学家对标注结果进行最终审核,解决标注者的分歧(如模糊裂缝的判定),并修正误判(如将缝合线、层理面排除在裂缝之外)。

最终,数据集标注的裂缝边缘总数达 127,659 条,经过验证后,标签准确率超过 95%,远高于行业平均水平(约 80%)。

三、GeoCrack 构建流程:从图像采集到数据集发布的全链路标准化

GeoCrack 的构建并非简单的 “拍照 + 标注”,而是一套涵盖 “数据采集 - 预处理 - 标注 - 补丁生成 - 验证” 的标准化流程,确保每一步都可复现、可追溯。

1. 图像采集:严格遵循摄影测量规范

为获取高质量原始图像,团队采用无人机(UAV)和地面相机结合的方式,严格控制拍摄条件:

- 设备选择:使用定焦镜头(避免畸变),型号包括大疆 Phantom 4 RTK、佳能 EOS R5 等,确保图像分辨率一致;

- 拍摄时机:优先选择阴天或太阳位于相机后方时拍摄,避免强光阴影和镜头眩光;

- 飞行参数:无人机飞行高度根据露头规模调整(5-50 米),确保地面采样距离(GSD)均匀(相邻像素地面距离误差 < 2%);

- 后期校正:使用 Agisoft Metashape 软件进行摄影测量后处理,自动消除镜头畸变,生成 ortho 影像(正射投影,无透视变形)。

2. 图像预处理:提升数据一致性

原始图像需经过 5 步处理,才能用于标注:

- 噪声去除:采用非局部均值滤波(NLM)+ 高斯滤波,去除传感器噪声和压缩伪影,同时保留裂缝边缘;

- 颜色平衡:使用 “灰度世界算法” 校正不同光照下的颜色偏差,确保同一岩性的颜色一致性;

- 对比度增强:通过直方图均衡化,提升裂缝与岩石的对比度(尤其针对风化严重的岩石);

- 边缘强化:使用基于 Hessian 矩阵的边缘检测算法,突出细微裂缝(如发丝状裂缝);

- 裁剪筛选:去除图像中的非地质区域(如天空、人工建筑),仅保留露头部分,并通过离散小波变换(DWT)量化运动模糊(模糊偏差 > 0.5% 的图像被剔除)。

3. 智能补丁生成:拒绝 “无效数据”

原始图像(4032×3024 像素)直接用于训练会导致计算量过大,因此需要切割为 224×224 的补丁。但并非所有补丁都有价值 —— 若某一补丁仅包含天空、植被或无裂缝的岩石,会降低训练效率。

GeoCrack 采用了智能补丁保留算法:

- 首要条件:补丁必须为完整的 224×224 像素(排除边缘不完整补丁);

- 次要条件:补丁中裂缝边缘面积占比≥25%(通过统计验证,25% 是 “保证数据有效性” 与 “保留足够样本” 的最优阈值)。

这一算法最终从 49 张原始图像中筛选出 12,158 个有效补丁,确保每一个样本都能为模型训练提供有效信息。

四、技术验证:U-Net 模型验证数据集有效性

为证明 GeoCrack 的实用性,团队使用经典的 U-Net 分割模型进行了验证实验:

- 训练数据:随机选取 1,245 个补丁(约 10% 的训练集);

- 评价指标:采用分割任务的核心指标 —— 交并比(IoU)、像素准确率(Pixel Accuracy)、召回率(Recall)、精确率(Precision);

- 实验结果:

- IoU:85%(裂缝分割的行业优秀水平为 80%-85%);

- 像素准确率:92%;

- 召回率:88%(漏检率仅 12%);

- 精确率:90%(误检率仅 10%)。

值得注意的是,这一结果是基于 “未调参的基础 U-Net 模型” 实现的 —— 若采用更先进的模型(如 U-Net++、SegFormer)或进行超参数优化,性能还可进一步提升。这充分说明:GeoCrack 提供的标签质量和数据多样性,完全满足深度学习模型的训练需求,且能有效支撑高精度裂缝分割任务。

五、数据获取与使用指南:开源共享,开箱即用

GeoCrack 秉持 “开源共建” 的理念,所有数据和代码均免费开放,方便科研人员快速上手:

1. 数据存储与结构

数据集托管于哈佛大学数据仓库(Dataverse),地址:https://doi.org/10.7910/DVN/E4OXHQ,分为三大文件夹:

- Raw Data:原始数据,包括未处理图像(Raw Images)、清洁后图像(Cleaned Images)、完整标签掩码(Edge Mask),以及包含 UTM 坐标、海拔、相机参数(型号、焦距、曝光时间)的元数据文件(metadata.txt);

- Patched Data:224×224 像素的 “图像 - 标签” 补丁对,按 “图像名_补丁编号_类型.png” 命名(如 “Oman_01_patch_001_mask.png”);

- Code:配套 Python 脚本,包括:

make_patches.py:生成补丁对的工具(支持自定义补丁尺寸和筛选阈值);make_dataset.py:自动划分训练 / 验证 / 测试集,并生成 CSV 文件;unet.py:基础 U-Net 模型实现,可直接用于测试数据集性能。

2. 推荐工具链

- 图像预处理:OpenCV(去噪、颜色校正)、ImageJ(手动标注辅助);

- 深度学习框架:PyTorch、TensorFlow(加载补丁数据);

- 标注工具:Adobe Photoshop(高精度标注)、LabelImg(快速标注)。

3. 数据使用注意事项

- 数据集采用CC BY-NC-ND 4.0 协议(非商业使用、不得修改、需注明出处);

- 若需扩展数据集(如新增岩性或区域),建议参考论文中的图像采集和标注规范,确保数据一致性;

- 针对小裂缝(<3px)的分割,需注意标注画笔尺寸(3px)可能带来的误差,可结合原始高分辨率图像进一步优化。

六、GeoCrack 的未来价值:不止于裂缝分割

GeoCrack 的意义远不止是 “一个数据集”—— 它为地质工程与人工智能的交叉研究提供了新的起点:

- 推动多类分割研究:当前 GeoCrack 仅标注了裂缝边缘(二分类),未来可扩展为 “裂缝 - 植被 - 阴影 - 人工干扰” 的多类分割,进一步提升模型的工程实用性;

- 支撑 3D 裂缝网络重建:结合摄影测量的点云数据,GeoCrack 的 2D 裂缝标注可用于训练 3D 裂缝分割模型,实现从 “平面标注” 到 “立体建模” 的跨越;

- 建立行业基准:GeoCrack 的发布将推动地质裂缝分割领域的 “标准化评测”—— 不同团队可基于同一数据集对比模型性能,避免 “自数据集自评估” 导致的结果偏差;

- 赋能工程落地:基于 GeoCrack 训练的模型,可集成到无人机巡检系统中,实现 “实时拍摄 - 自动分割 - 裂缝统计” 的全流程自动化,将传统需要数天的露头调查缩短至数小时,大幅提升工程效率。

七、下载地址

GeoCrack: A High-Resolution Dataset For Segmentation of Fracture Edges in Geological Outcrops

为方便国内同学下载,已转一份到百度网盘:

结语:从数据驱动到技术突破

GeoCrack 的发布,标志着地质裂缝分析正式进入 “数据驱动” 的新时代。它不仅解决了深度学习训练的数据瓶颈,更以 “还原真实场景、保证标注精度” 的设计理念,为科研人员提供了一个贴近工程需求的 “试验场”。未来,随着更多科研团队基于 GeoCrack 开展创新(如轻量化模型设计、小样本学习、跨模态融合),我们有理由相信,自动化、高精度的裂缝提取技术将更快落地,为油气开发、地质灾害防治、碳中和等国家战略需求提供更有力的技术支撑。

若你正在从事地质工程、计算机视觉或相关交叉领域的研究,不妨从 GeoCrack 开始 —— 或许,下一个突破就源于这份数据集。

引用格式:Yaqoob, M., Ishaq, M., Ansari, M.Y. et al. GeoCrack: A High-Resolution Dataset For Segmentation of Fracture Edges in Geological Outcrops. Sci Data 11, 1318 (2024). https://doi.org/10.1038/s41597-024-04107-0

评论区